56 % der deutschen Unternehmen nutzen bereits ChatGPT, Microsoft Copilot oder Google Gemini im Alltag – aber nur 27 % haben ihre Mitarbeiter jemals dazu geschult. Das ist die Kernerkenntnis der TÜV-Weiterbildungsstudie 2026. Bei kleinen Unternehmen (20–49 Mitarbeitern) liegt die Quote bei nur 21 %, bei Großunternehmen ab 250 Mitarbeitern immerhin bei 49 %. Die Differenz zwischen „wir machen KI" und „wir können KI verantwortungsvoll" ist 2026 das größte ungelöste Compliance-Risiko vieler Mittelständler.

Genau hier setzt Artikel 4 der EU-Verordnung 2024/1689 – besser bekannt als EU AI Act – an. Die Pflicht zur sogenannten „AI Literacy" gilt seit dem 2. Februar 2025. Ab dem 2. August 2026 starten die nationalen Marktüberwachungsbehörden mit der Durchsetzung. In Deutschland soll das die Bundesnetzagentur (BNetzA) übernehmen, sobald das nationale Umsetzungsgesetz – das KI-Marktüberwachungs- und Innovationsförderungsgesetz (KI-MIG) – verabschiedet ist. Stand heute liegt es im Gesetzgebungsverfahren.

Die gute Nachricht: Die Pflicht ist deutlich pragmatischer formuliert, als viele befürchten. Es gibt keine Zertifizierungspflicht, keinen verpflichtenden KI-Beauftragten und keine vorgeschriebene Wissensprüfung. Das hat das EU AI Office in seiner offiziellen FAQ „AI Literacy – Questions & Answers" klar bestätigt. Die schlechte Nachricht: Trotzdem müssen Sie nachweisen können, dass Sie sich darum gekümmert haben.

Dieser Artikel zeigt Ihnen, was Art. 4 wirklich verlangt, was die mögliche Abschwächung im Rahmen des Digital Omnibus on AI vom 7. Mai 2026 bedeutet, und wie Sie ein rechtssicheres Schulungsprogramm in vier praktischen Schritten aufsetzen – ohne Bürokratie-Theater.

Die wichtigsten Zahlen auf einen Blick

Seit 2. Februar 2025 ist Artikel 4 EU AI Act in Kraft – verbindlich für Anbieter und Betreiber von KI-Systemen, unabhängig von der Unternehmensgröße.

Ab 2. August 2026 starten die nationalen Marktüberwachungsbehörden mit der Durchsetzung. In Deutschland: Bundesnetzagentur (BNetzA), sobald das KI-MIG verabschiedet ist.

41 % der deutschen Unternehmen ab 20 Beschäftigten nutzen KI bereits aktiv, weitere 48 % planen oder diskutieren den Einsatz – rechnerisch mehr als eine Verdopplung gegenüber dem Vorjahr (2025: 17 % aktive Nutzung, Bitkom Research, März 2026).

Nur 27 % der Unternehmen haben ihre Mitarbeiter zu KI geschult, obwohl 56 % generative KI-Tools wie ChatGPT bereits im Einsatz haben (TÜV-Verband, Forsa-Befragung 2026).

Bußgeldrahmen der KI-Verordnung allgemein: bis zu 35 Mio. € oder 7 % des weltweiten Jahresumsatzes für verbotene Praktiken (Art. 5), bis zu 15 Mio. € oder 3 % für andere Operator-Pflichten (Art. 99(4)). Spezifische Sanktionen für Art.-4-Verstöße werden in Deutschland erst durch das KI-MIG geregelt.

Aktuelle Klarstellungen: Die offizielle „AI Literacy – Q&A"-Seite des EU AI Office bestätigt: kein Zertifikat, keine verpflichtende Wissensmessung, kein KI-Beauftragter wie der DSB.

7. Mai 2026: EU-Parlament und Rat erzielen vorläufige Einigung im Digital Omnibus on AI – Hochrisiko-Pflichten für Annex-III-Systeme werden auf den 2. Dezember 2027 verschoben (statt 2. August 2026). Eine geplante Abschwächung von Art. 4 selbst ist Teil des Verhandlungspakets, aber noch nicht förmlich beschlossen.

1. Was Artikel 4 EU AI Act tatsächlich verlangt

Der Wortlaut von Artikel 4 EU AI Act ist erstaunlich kurz – und das ist ausnahmsweise gut. Der gesamte Artikel passt in einen Satz:

„Die Anbieter und Betreiber von KI-Systemen ergreifen Maßnahmen, um nach besten Kräften sicherzustellen, dass ihr Personal und andere Personen, die in ihrem Auftrag mit dem Betrieb und der Nutzung von KI-Systemen befasst sind, über ein ausreichendes Maß an KI-Kompetenz verfügen, wobei ihre technischen Kenntnisse, ihre Erfahrung, ihre Ausbildung und Schulung und der Kontext, in dem die KI-Systeme eingesetzt werden sollen, sowie die Personen oder Personengruppen, bei denen die KI-Systeme eingesetzt werden sollen, zu berücksichtigen sind."

Daraus ergeben sich vier Eckpfeiler, die Sie kennen müssen:

Bemühungspflicht, keine Erfolgspflicht

Sie müssen „nach besten Kräften" handeln – nicht garantieren, dass jeder Mitarbeiter KI perfekt versteht. Das senkt die Latte erheblich, verlangt aber dokumentierte, nachvollziehbare Maßnahmen.

Personal und Auftragnehmer

Erfasst sind Angestellte, freie Mitarbeiter, Dienstleister, Auftragnehmer – kurz: alle, die in Ihrem Auftrag mit den KI-Systemen arbeiten. Der Werkstudent oder der externe Berater fällt also genauso darunter wie Ihre Festangestellten.

Risikobasiert & rollenspezifisch

Die Schulung muss sich am Kontext orientieren: Eine Person, die einen ChatGPT-Plus-Account für Recherche nutzt, braucht weniger Tiefe als ein Team, das ein KI-Lead-Scoring im Vertrieb betreibt. Risiko und Rolle bestimmen die Tiefe.

KMU sind nicht ausgenommen

Anders als bei einigen DSGVO-Pflichten gibt es bei Art. 4 keine Bagatellgrenze. Auch der 15-Mitarbeiter-Mittelständler muss handeln – allerdings angepasst an Größe, Risiko und Kontext.

Die ergänzende Definition der „KI-Kompetenz" findet sich in Art. 3 Nr. 56 der Verordnung. Sinngemäß: Fähigkeiten, Kenntnisse und Verständnis, die es ermöglichen, KI-Systeme sachkundig einzusetzen, ihre Chancen und Risiken zu verstehen und mögliche Schäden zu vermeiden – jeweils angepasst an die Rechte und Pflichten der jeweiligen Person.

Das ist bewusst breit gehalten. Es geht nicht um technisches Tiefenverständnis von Transformer-Architekturen oder Token-Embeddings. Es geht um drei Dinge:

- Verstehen, was KI ist – auf einem Niveau, das die eigene Rolle im Unternehmen abdeckt.

- Risiken erkennen – Halluzinationen, Bias, Datenschutz, Vertraulichkeit, Vendor-Lock-in.

- Verantwortungsvoll handeln – Wann eine KI-Antwort prüfen, wann eskalieren, wann nicht nutzen?

Wer schon einmal eine DSGVO-Schulung für Mitarbeiter organisiert hat, wird die Logik wiedererkennen – nur ist die Breite hier größer, weil KI nicht auf eine Abteilung beschränkt bleibt.

2. Wer ist betroffen? Anbieter, Betreiber, „andere Personen"

Die Verordnung unterscheidet streng zwischen zwei Hauptrollen – und die meisten deutschen Unternehmen sind in ihrer Rolle als „Betreiber" (engl. deployer) unterwegs, ohne es zu wissen. Wer ChatGPT Enterprise einkauft und an seine Mitarbeiter ausrollt, ist Betreiber im Sinne des Gesetzes. Wer ein eigenes KI-System entwickelt oder vermarktet, ist Anbieter (engl. provider) – beides kann gleichzeitig zutreffen.

| Rolle | Definition | Typisches Beispiel | Was Art. 4 verlangt |

|---|---|---|---|

| Anbieter (Provider) | Wer KI-Systeme entwickelt oder unter eigenem Namen in Verkehr bringt | SaaS-Anbieter mit eigener KI-Funktion, KI-Startup, OEM-Hersteller mit KI im Produkt | Eigenes Personal + Auftragnehmer schulen, plus Dokumentation für Konformität |

| Betreiber (Deployer) | Wer KI-Systeme im eigenen Unternehmen unter eigener Verantwortung einsetzt | Mittelstand, der ChatGPT Enterprise / Copilot / Plotdesk im Alltag nutzt | Personal + Auftragnehmer schulen, dokumentieren, regelmäßig auffrischen |

| Beide gleichzeitig | Wer ein gekauftes KI-System wesentlich umbaut oder unter eigenem Namen weiterverkauft | Agentur, die Plotdesk White-Label an eigene Kunden vermarktet | Beide Pflichten kumulativ – plus Schulung der Endkunden im eigenen Verantwortungsbereich |

Faustregel für die Praxis

Wenn Sie KI-Tools in Ihrem Unternehmen einsetzen (Standard-Fall im Mittelstand), sind Sie Betreiber. Wenn Sie ein KI-System entwickeln oder unter eigenem Namen anbieten, sind Sie Anbieter – und müssen zusätzlich umfangreichere Konformitätspflichten erfüllen, sobald das System als Hochrisiko eingestuft wird. Die Schulungspflicht aus Art. 4 trifft beide gleichermaßen.

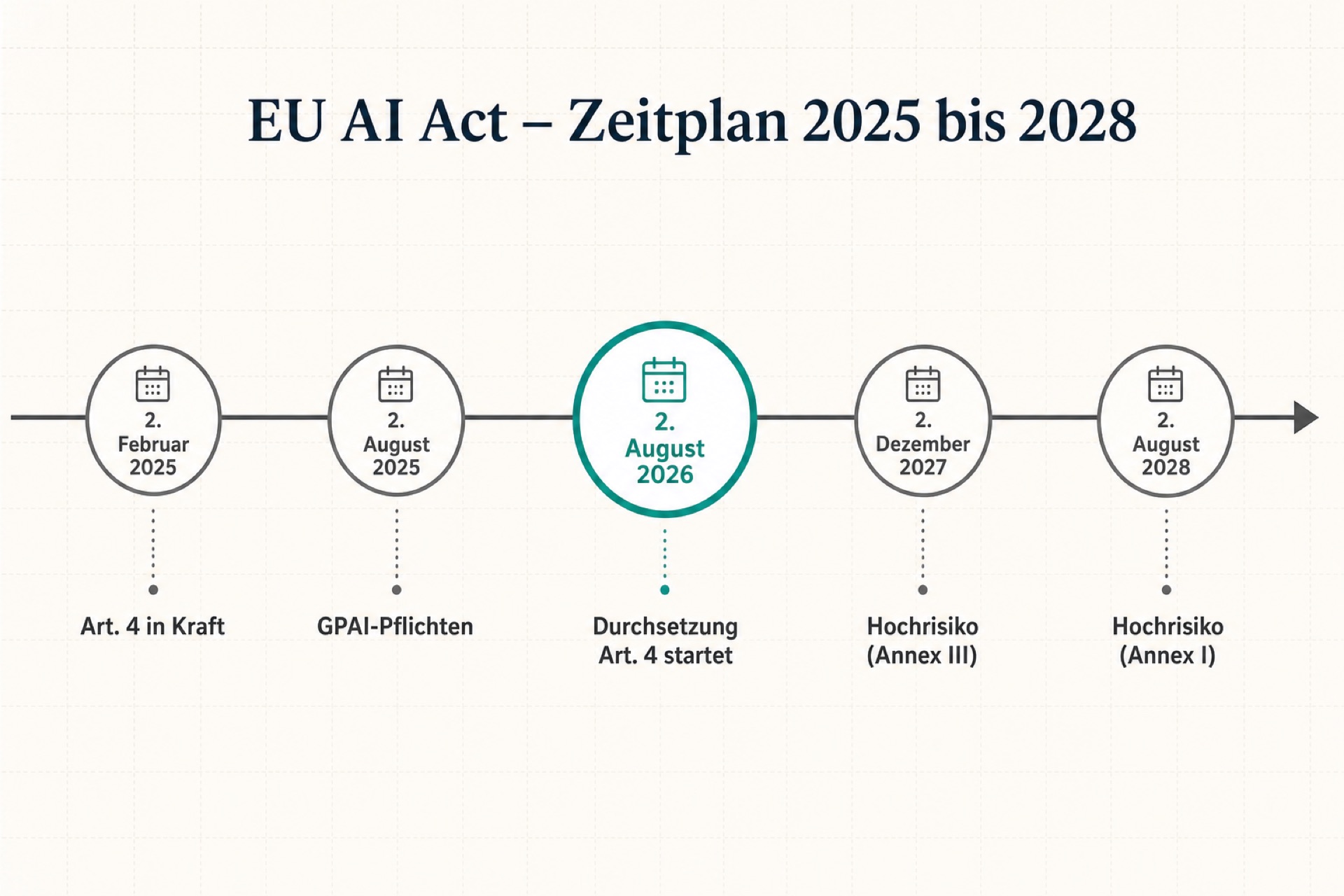

3. Der Zeitplan: Was wann gilt – inklusive Digital-Omnibus-Update

Die Verordnung 2024/1689 wurde am 12. Juli 2024 im EU-Amtsblatt veröffentlicht und ist am 1. August 2024 in Kraft getreten. Die Pflichten gelten gestaffelt:

2025

Art. 4 KI-Kompetenz und Art. 5 Verbote gelten

Kapitel I und II der Verordnung gelten. Verbotene KI-Praktiken (Social Scoring, manipulative Systeme etc.) sind unmittelbar untersagt. Art. 4 verpflichtet Anbieter und Betreiber zur KI-Kompetenz – noch ohne flächendeckende Sanktionsmöglichkeit, aber rechtlich bindend.

2025

GPAI-Pflichten + nationale Aufsicht

Pflichten für Allzweck-KI (General Purpose AI, GPAI) starten. Mitgliedstaaten sollen bis zu diesem Datum nationale Marktüberwachungsbehörden benannt haben. Deutschland hat diese Frist verpasst – das KI-MIG (Bundeskabinett am 11. Februar 2026 beschlossen) ist Stand heute noch nicht durch Bundestag und Bundesrat.

2026

Volle Anwendung & Durchsetzung Art. 4

Ab diesem Datum können nationale Marktüberwachungsbehörden Verstöße gegen Art. 4 aktiv ahnden. Die konkreten Bußgelder ergeben sich aus dem nationalen KI-MIG. Die geplanten Hochrisiko-Pflichten für Annex-III-Systeme werden gemäß Digital-Omnibus-Einigung vom 7. Mai 2026 voraussichtlich verschoben (siehe unten).

2027

Hochrisiko-Pflichten Annex III (verschoben)

Ursprünglich am 2. August 2026 vorgesehen. Im Rahmen des Digital Omnibus haben EP und Rat am 7. Mai 2026 eine vorläufige Einigung erzielt, die Anwendung um ca. 16 Monate auf den 2. Dezember 2027 zu verschieben. Förmliche Verabschiedung steht noch aus, wird aber vor August 2026 erwartet.

2028

Hochrisiko-Pflichten Annex I (verschoben)

Anwendung der Hochrisiko-Pflichten für KI in regulierten Produkten (Anhang I). Ursprünglich der 2. August 2027, im Digital Omnibus auf 2. August 2028 verschoben.

Wichtig: Was der Digital Omnibus für Art. 4 selbst bedeutet

Die Europäische Kommission hat im Vorschlag zum Digital Omnibus (19. November 2025) vorgeschlagen, die unmittelbare Pflicht aus Art. 4 für Anbieter und Betreiber zu streichen und durch eine reine Förderaufgabe von Kommission und Mitgliedstaaten zu ersetzen. Geleakte Kompromisstexte deuten darauf hin, dass eine Abschwächung Teil des Trilog-Deals vom 7. Mai 2026 ist. Die offiziellen Press Releases von EP und Rat schweigen jedoch zu Art. 4. Der Europäische Datenschutzausschuss (EDPB) und der EDPS haben in ihrer Joint Opinion 1/2026 vom 20. Januar 2026 vor einer Abschwächung gewarnt.

Was das für Sie bedeutet: Stand heute (Mai 2026) ist Art. 4 rechtlich voll bindend. Wer jetzt anfängt, ein Schulungsprogramm aufzubauen, ist auf der sicheren Seite – egal, wie der finale Text aussieht. Wer wartet, bis der Digital Omnibus förmlich verabschiedet ist, riskiert, dass die Pflicht in unveränderter oder kaum veränderter Form bestehen bleibt und für die Vorbereitung dann zu wenig Zeit ist.

4. Bußgelder – die ehrliche Einordnung

In Compliance-Webinaren wird häufig mit „bis zu 15 Mio. € oder 3 % des weltweiten Jahresumsatzes" für Art.-4-Verstöße geworben. Das ist nicht ganz korrekt und sollte differenziert werden. Der Bußgeldrahmen der KI-Verordnung steckt in Artikel 99:

| Verstoß | Bußgeldrahmen | Rechtsgrundlage |

|---|---|---|

| Verbotene KI-Praktiken (Art. 5) | bis zu 35 Mio. € oder 7 % des weltweiten Jahresumsatzes | Art. 99 Abs. 3 |

| Bestimmte Operator- und Notified-Body-Pflichten | bis zu 15 Mio. € oder 3 % des weltweiten Jahresumsatzes | Art. 99 Abs. 4 |

| Falsche oder irreführende Auskünfte gegenüber Behörden | bis zu 7,5 Mio. € oder 1 % des weltweiten Jahresumsatzes | Art. 99 Abs. 5 |

| KMU / Start-ups | jeweils der niedrigere Wert | Art. 99 Abs. 6 |

Die Liste in Art. 99 Abs. 4 ist abschließend – sie nennt namentlich die Artikel 16, 22, 23, 24, 26, 31, 33, 34 und 50. Artikel 4 ist dort nicht enthalten. Die EU-Verordnung selbst sieht für reine Art.-4-Verstöße also keinen unmittelbaren EU-weiten Bußgeldrahmen vor. Das hat das EU AI Office in seiner aktuellen Q&A bestätigt: „National market surveillance authorities could impose penalties and other enforcement measures to sanction infringements of Article 4. This will be based on national laws."

In Deutschland werden die konkreten Sanktionen für Art.-4-Verstöße erst durch das KI-Marktüberwachungs- und Innovationsförderungsgesetz (KI-MIG) geregelt. Das Bundeskabinett hat den Entwurf am 11. Februar 2026 beschlossen, das Gesetz befindet sich Stand Mai 2026 weiterhin im parlamentarischen Verfahren. Bis es in Kraft tritt, ist der praktische Sanktionsdruck für Art. 4 in Deutschland gering – aber das ändert nichts an der Pflicht selbst. Wer als Betreiber für KI-bedingte Schäden zivilrechtlich oder arbeitsrechtlich in Anspruch genommen wird, dürfte sich künftig an Art. 4 messen lassen müssen.

5. Die fünf häufigsten Mythen über die KI-Schulungspflicht

„Art. 4 betrifft nur große Unternehmen."

Falsch. Es gibt keine Bagatellgrenze und keine KMU-Ausnahme. Auch der Drei-Personen-Betrieb mit ChatGPT-Plus-Abo ist betroffen – die Maßnahmen müssen aber verhältnismäßig zur Größe und zum Risiko sein.

„Wir brauchen jetzt einen KI-Beauftragten wie den DSB."

Falsch. Die offizielle AI-Office-FAQ stellt klar: Es gibt keine Pflicht, eine eigene Rolle einzurichten. Eine klare Verantwortungszuweisung im bestehenden Setup (z. B. IT-Leitung, Datenschutz, Compliance) reicht aus.

„Wir müssen jeden Mitarbeiter mit einem Test prüfen."

Falsch. Eine verpflichtende Wissensprüfung oder gar Zertifizierung ist nicht vorgesehen. Eine plausible Schulungsdokumentation reicht – wobei interne Tests freiwillig sehr sinnvoll sein können, um Wirksamkeit zu messen.

„Eine einmalige Schulung reicht."

Tendenziell falsch. Die Verordnung macht keine konkrete Frequenz vor – aber bei der rasanten Entwicklung neuer Modelle und Funktionen (allein im Frühjahr 2026 erschienen mehrere neue Frontier-Modelle) ist eine jährliche Auffrischung der Mindeststandard.

„Der Digital Omnibus schafft Art. 4 ab – wir können warten."

Riskant. Die offiziellen Press Releases von EP und Rat zur Trilog-Einigung vom 7. Mai 2026 erwähnen Art. 4 nicht. Geleakte Kompromisstexte deuten auf eine Abschwächung hin, aber der EDPB hat ausdrücklich davor gewarnt. Selbst wenn Art. 4 entschärft wird: Der Bedarf nach KI-kompetenten Mitarbeitern bleibt – schon allein aus operativen, haftungs- und arbeitsschutzrechtlichen Gründen.

6. Vier Kompetenzlevel – und was sie pro Rolle bedeuten

Die Verordnung gibt keine konkreten Curricula vor. Aus Sicht der Praxis hat sich aber ein vierstufiges Kompetenzmodell etabliert, das sich an der jeweiligen Rolle orientiert:

Level 1 – Grundlagen für alle

Zielgruppe: Jeder Mitarbeiter mit Zugang zu KI-Tools – auch indirekt, etwa über Microsoft 365 mit Copilot oder integrierten KI-Funktionen in CRM/ERP.

Mindestinhalte:

- Was ist generative KI? (Grundbegriff Large Language Model, kurze Geschichte)

- Stärken und typische Schwächen (Halluzinationen, Bias, Wissensstand-Cutoff)

- Datenschutz-Basics: Welche Daten dürfen rein, welche nicht?

- Verbotene Praktiken nach Art. 5 EU AI Act (kurzer Überblick)

- Wem im Unternehmen melde ich Auffälligkeiten?

Realistischer Aufwand: 30–60 Minuten als E-Learning oder Live-Workshop.

Level 2 – Operativ aktive Nutzer

Zielgruppe: Mitarbeiter, die KI-Tools regelmäßig im Tagesgeschäft einsetzen – z. B. im Marketing, Sales, Support, in der Verwaltung.

Mindestinhalte:

- Praxis-Prompting: Klare Aufgaben, Kontext liefern, iterieren – ein Einstieg in den Bereich Prompt Engineering.

- Prüfen vor Versenden: Vier-Augen-Prinzip für externe Kommunikation

- Umgang mit vertraulichen Daten in KI-Tools (Sensitivity-Labeling, abgeschottete Workspaces)

- Erkennung von Halluzinationen, einfache Quellenprüfung

- Wann KI gar nicht nutzen? (z. B. Personalentscheidungen, medizinische Empfehlungen ohne Fachperson)

Realistischer Aufwand: 2–4 Stunden Workshop plus 1 Stunde Selbstlern-Material.

Level 3 – Verantwortlich entscheidende Anwender

Zielgruppe: Personen, die KI-gestützte Entscheidungen treffen oder mit KI eigenständig Geschäftsergebnisse produzieren – z. B. Teamleitungen, Power-User, Champions, Personen in Vertrieb/HR/Recht.

Mindestinhalte:

- Modellvergleich: Stärken und Schwächen der wichtigsten Frontier-Modelle (GPT, Claude, Gemini, Mistral) – siehe unser Modellvergleich.

- RAG & eigene Wissensbasen: Wann ergibt das Anbinden interner Daten Sinn? – mehr im Artikel zu RAG (Retrieval Augmented Generation).

- EU-AI-Act-Risikoklassen verstehen, eigene Use-Cases einordnen

- Bias und Fairness in KI-Outputs erkennen, dokumentieren, mitigieren

- Eskalationspfade: Wann muss IT/Compliance/Datenschutz einbezogen werden?

Realistischer Aufwand: 1–2 ganztägige Workshops pro Jahr plus regelmäßige Update-Sessions.

Level 4 – Strategisch verantwortliche Führung

Zielgruppe: Geschäftsführung, Vorstand, IT-Leitung, Datenschutzbeauftragte, Compliance, Betriebsrat.

Mindestinhalte:

- Regulatorischer Gesamtrahmen: EU AI Act + DSGVO + Branchenrecht (BaFin, MaRisk, MDR …)

- Pflichten als Anbieter vs. Betreiber, Hochrisiko-Kategorien (Annex I + III)

- Strategische Plattform-Entscheidung: Eine Plattform statt Tool-Wildwuchs (Stichwort Shadow AI vermeiden).

- Souveränitäts- und Hosting-Optionen: EU-Region, Sovereign Cloud, On-Prem (siehe Souveräne KI 2026).

- KI-Governance, Verantwortlichkeiten, Berichtswege, Reaktion auf Vorfälle

- Mitbestimmung des Betriebsrats (§ 87 BetrVG) – Details im Artikel zu Betriebsrat & KI.

Realistischer Aufwand: Halbtägiger Executive-Workshop plus Quartals-Updates zur regulatorischen Lage.

So setzen Sie die vier Level praktisch um

Eine sinnvolle Faustregel: Level 1 muss jeder durchlaufen (idealerweise im Onboarding plus jährlich). Level 2 betrifft typischerweise 30–60 % der Belegschaft. Level 3 und 4 sind kleinere Gruppen (5–15 % zusammen), bei denen sich auch externe Tagesworkshops oder strukturierte Lernpfade lohnen. Wer zusätzlich ein Champions-Netzwerk aufbaut (eine geschulte Person je Abteilung), erhöht die Adoption signifikant – siehe unser Change-Management-Leitfaden.

7. Die 4-Schritte-Roadmap zur rechtssicheren Umsetzung

Statt aus dem Stand ein 50-seitiges Konzept zu schreiben, hat sich in der Praxis ein iterativer Ansatz bewährt. Die folgende Roadmap lässt sich in 6 bis 10 Wochen abarbeiten und liefert eine prüffeste Grundlage für den 2. August 2026.

KI-Inventur machen

Listen Sie alle KI-Tools auf, die in Ihrem Unternehmen eingesetzt werden – inklusive der „grauen" Nutzung. Erfahrungsgemäß tauchen 3–5 Tools auf, die offiziell gar nicht freigegeben sind. Diese Shadow-AI-Inventur ist die Basis für alles Weitere.

Pro Tool dokumentieren: Anbieter, Hosting-Region, Vertragsstatus (AVV?), Anzahl Nutzer, Use Case, Risikoeinschätzung.

Rollen klassifizieren und Lernpfade zuordnen

Mappen Sie Ihre Belegschaft auf die vier Kompetenzlevel L1–L4. In den allermeisten Fällen entstehen daraus drei bis vier Lernpfade, die organisationsweit gelten – statt 20 individueller Curricula.

Tipp: HR-Stammdaten + IT-Berechtigungslisten machen das in einem halben Tag möglich. Pro Person das höchste relevante Level dokumentieren.

Schulungsformate festlegen und ausrollen

Für L1 reicht häufig ein gut produziertes E-Learning (30–60 Min) plus jährliche Auffrischung. L2 lohnt sich als Live-Workshop pro Abteilung. L3 und L4 kombinieren externe Expertise mit internen Use-Case-Sessions. Wichtig: Anwesenheits- und Abschlussnachweise dokumentieren – am besten direkt im LMS oder im Personalsystem.

Wer noch kein LMS hat: Eine schlanke Dokumentation in Confluence, SharePoint oder einem internen Tool reicht aus, solange sie für externe Auditoren nachvollziehbar ist.

Governance-Anker setzen und jährlich nachschärfen

Die Maßnahmen brauchen einen Owner – im Mittelstand häufig die Schnittstelle aus IT-Leitung, Datenschutzbeauftragten und HR. Ein einfacher Dreisatz reicht: (a) KI-Nutzungsrichtlinie als Dokument, (b) verbindliches Schulungsprogramm pro Lernpfad, (c) jährliche Review-Schleife mit Update der Inhalte (neue Modelle, neue Use-Cases, neue Vorfälle).

Risikobasiert heißt: Wenn sich Modelle, Tools oder Use Cases wesentlich ändern, ist eine Ad-hoc-Auffrischung schlauer als das starre Jahresraster.

8. Was Sie für den Audit dokumentieren sollten

Die EU-Verordnung verlangt für Art. 4 keine spezifische Aufbewahrungsfrist und kein vorgeschriebenes Format. Faustregel aus Praxis und Beratungstradition: Was bei der DSGVO-Audit-Vorbereitung als „angemessen" gilt, gilt auch hier.

Folgende Dokumente sollten Sie jederzeit vorlegen können:

Audit-Mindestpaket für Artikel 4 EU AI Act

-

KI-Nutzungsrichtlinie als unternehmensweit gültiges Dokument (1–4 Seiten reichen meist; klar formulierte Do's und Don'ts).

-

KI-Inventur: Liste aller eingesetzten KI-Tools mit Anbieter, Hosting-Region, Risikoklasse und Verantwortlichen.

-

Lernpfad-Definition: Welche Rolle benötigt welches Kompetenzlevel? (Tabelle reicht.)

-

Schulungsnachweise pro Person: Datum, Inhalt, Dauer, Format. Gerne im LMS, alternativ in Listenform.

-

Schulungsmaterialien selbst – also die Folien, E-Learning-Inhalte, Workshop-Notizen, mit denen geschult wurde.

-

Regelmäßige Reviews: Notiz, wann zuletzt überprüft wurde, welche Anpassungen aufgrund neuer Modelle oder Vorfälle vorgenommen wurden.

-

Verantwortungszuweisung: Wer ist im Unternehmen für die Pflege der Maßnahmen zuständig? (z. B. IT-Leitung in Abstimmung mit DSB.)

-

Vorfall-Logbuch: Falls es Vorfälle gab – Halluzinationen mit echtem Schaden, Datenleck, Bias-Fall – dokumentieren Sie Ursache, Reaktion und Lerneffekt für die nächste Schulung.

Was Sie weglassen können

Sparen Sie sich aufwändige Bürokratie, die nicht verlangt ist:

- Keine Pflichtzertifikate oder externe „TÜV-Plaketten" für Mitarbeiter.

- Keine verpflichtende Wissensprüfung – freiwillige Tests sind zulässig, aber nicht erforderlich.

- Kein dedizierter „KI-Beauftragter" im Sinne eines Datenschutzbeauftragten.

- Keine behördliche Anzeige oder Registrierung der Schulung.

Wer hier von externen Anbietern „Pflicht-Zertifizierungen" verkauft bekommt, sollte zumindest skeptisch nachfragen.

9. Typische Stolperfallen – und wie Sie sie umgehen

Schulung „nach Wasserglas"

Eine 90-Minuten-Pflichtveranstaltung, in der niemand Fragen stellt – das hält keine Plausibilitätsprüfung. Lieber kürzere, aber mehrere Formate kombinieren (Video + Live-Q&A + Use-Case-Übung).

Auftragnehmer vergessen

Externe Berater, Werkstudenten, Agentur-Mitarbeiter – sie alle fallen unter Art. 4. Vertraglich verankern, dass entweder die Schulung beim Vertragspartner liegt oder zugang zu Ihrem Schulungsmaterial gegeben wird.

Microsoft Copilot „rutscht durch"

Viele Unternehmen unterschätzen, dass Copilot-Funktionen automatisch in Word, Excel, Teams auftauchen. Mitarbeiter „nutzen" KI, ohne es bewusst zu wissen. Diese Personen brauchen mindestens Level 1.

Veraltetes Material

Ein Schulungsdeck von 2024 mit „GPT-4" als modernstem Modell ist 2026 ein Negativsignal. Inhalte sollten so aktuell sein wie die genutzten Tools – mindestens jährliches Review.

Betriebsrat zu spät einbeziehen

Schulungs- und Nutzungsrichtlinien können mitbestimmungspflichtig sein (§ 87 BetrVG). Frühzeitig einbeziehen erspart Konflikte – ausführlich im Artikel zu Betriebsrat & KI.

Kein klarer Owner

„Macht doch IT" oder „macht doch HR" führt dazu, dass nichts passiert. Klare Verantwortungszuweisung mit Quartals-Status reicht – Hauptsache, jemand fühlt sich am Ende des Jahres befragbar.

10. Drei Beispiel-Szenarien aus der Praxis

So unterschiedlich sich die Schulungspflicht auswirkt, so unterschiedlich sehen die Lösungen aus. Drei stilisierte, aber realistische Szenarien aus dem deutschen Mittelstand:

Ausgangslage: Microsoft 365 mit Copilot, eine eigene KI-Plattform für Konstruktion und Service. KI-Nutzung breit, aber nur teils freigegeben.

Lösung: 60-Minuten-E-Learning (L1) für alle 280 Personen im Onboarding und jährlich; 4-Stunden-Workshops (L2) pro Abteilung mit konkreten Use-Cases; halbtägiger L3-Workshop für 22 Power-User; Quartals-Update für Geschäftsleitung (L4).

Aufwand: ca. 280 Stunden Personalzeit im ersten Jahr, danach ca. 90 Stunden jährlich für Pflege und Auffrischung.

Ausgangslage: ChatGPT-Team-Lizenzen, gelegentlich Claude. Keine eigene Entwicklung, reine Nutzung.

Lösung: 45-Minuten-Workshop für alle 35 Personen (L1+L2 kombiniert), schriftliche Nutzungsrichtlinie (2 Seiten), zwei externe Tagesworkshops für Geschäftsführung und Operations-Lead (L3/L4). Auffrischung jährlich in einer Stunde.

Aufwand: ca. 40 Stunden Personalzeit im ersten Jahr, ca. 15 Stunden jährlich. Externe Beratung optional, ca. 1–2 Tage.

Ausgangslage: Hochregulierte Branche, eigene KI-Plattform mit RAG, mehrere Hochrisiko-Kandidaten (HR-Tools, Kreditprüfung).

Lösung: Pflicht-E-Learning (L1) im LMS, automatisierte Erinnerungen, Reporting an Compliance; halbtägige L2-Workshops in Wellen pro Abteilung; dezidierte L3-Programme für Power-User pro Use-Case; Quartals-Briefing der Vorstandsebene (L4) inkl. Audit-Vorbereitung mit Wirtschaftsprüfer und Datenschutzbeauftragten.

Aufwand: Sechsstelliger Personal- und Beratungsaufwand im ersten Jahr, danach jährliche Pflege als Teil eines KI-Governance-Programms.

11. Wo eine KI-Plattform die Schulungspflicht praktisch entschärft

Die Schulungspflicht ist kein reines Bildungsthema – sie hängt eng mit der Frage zusammen, welche KI-Tools Sie überhaupt im Einsatz haben. Wer mit zehn unterschiedlichen Tools arbeitet (ChatGPT für Marketing, Copilot in Office, ein eigenes Bot-Skript für Support, ein paar persönlich genutzte Plus-Accounts), muss faktisch zehn Mini-Schulungen aufsetzen. Wer auf eine zentrale Plattform setzt, schult einmal die Plattform – und kann den Rest über Berechtigungen, Vorlagen und Audit-Logs orchestrieren.

Das zeigt sich besonders in vier Bereichen:

1. Einheitliches Schulungsmaterial statt Tool-Wirrwarr

Die Mitarbeiter lernen eine Oberfläche, eine Berechtigungslogik, einen Eskalationsweg. Das macht Schulungen kürzer, verständlicher – und reduziert die Update-Last bei jedem neuen Modell.

2. Audit-Logs als Schulungs-Belege

Wenn die Plattform protokolliert, wer wann was getan hat – inklusive Tutorials, Hilfe-Aufrufen oder Sandbox-Nutzung – entstehen automatisch Hinweise auf Schulungsbedarf. Wer drei Wochen lang denselben Fehler macht, kann gezielt nachgeschult werden.

3. Berechtigungen als Lernanreiz

In einer professionellen Plattform sind Funktionen rollenbasiert: Wer L2 abgeschlossen hat, bekommt Zugang zu sensibleren Use Cases. Wer L3 abgeschlossen hat, darf eigene Vorlagen erstellen. So wird die Schulung nicht zur Pflichtübung, sondern zum Türöffner.

4. Inline-Hilfe statt PDF-Manual

Eine Plattform mit guten Templates, Vorlagen, Beispielen und Inline-Hinweisen reduziert die Notwendigkeit für externe Schulungen, weil das Lernen am Arbeitsplatz selbst stattfindet – kontinuierlich und kontextspezifisch.

Die EU verlangt von Ihnen nicht, jeden Mitarbeiter zum Daten-Wissenschaftler auszubilden. Sie verlangt, dass Ihr Unternehmen nachweisen kann, sich um die richtigen Kompetenzen gekümmert zu haben. Eine konsolidierte KI-Plattform mit klarer Berechtigungslogik ist dafür meistens das wirksamere Werkzeug als jedes einzelne Schulungs-PDF.

Fazit: Was Sie in den nächsten 80 Tagen tun sollten

Bis zum 2. August 2026 sind es heute (15. Mai 2026) noch knapp 79 Tage. Wer jetzt anfängt, schafft eine ordentliche Grundlage. Wer wartet, riskiert hektische Improvisation – und je nach finaler Verabschiedung des Digital Omnibus eventuell trotzdem die volle Pflicht.

Die fünf wichtigsten Punkte aus diesem Artikel:

- Art. 4 ist seit dem 2. Februar 2025 in Kraft und gilt für Anbieter und Betreiber – inklusive KMU, freier Mitarbeiter und Auftragnehmer. Der Digital Omnibus könnte die Pflicht abschwächen, ist aber Stand heute nicht förmlich verabschiedet.

- Durchsetzung startet am 2. August 2026 durch nationale Marktüberwachungsbehörden. In Deutschland: BNetzA, sobald das KI-MIG verabschiedet ist.

- Es geht um eine Bemühungspflicht, nicht um eine Erfolgs- oder Zertifizierungspflicht. Maßnahmen sollen rollenspezifisch und risikobasiert sein – nicht „one-size-fits-all".

- Vier Kompetenzlevel (Grundlagen, Operativ, Verantwortlich, Strategisch) decken in den meisten Unternehmen die gesamte Belegschaft ab. Der Aufwand ist machbar – im Mittelstand häufig 2–6 Wochen für die Erst-Aufsetzung.

- Eine konsolidierte Plattform reduziert die Schulungslast deutlich, weil Mitarbeiter eine statt zehn Oberflächen lernen, Berechtigungen die Lernziele unterstützen und Audit-Logs die Dokumentation übernehmen.

Der wichtigste Satz dieses Artikels: Die Schulungspflicht ist kein Bürokratie-Theater – sie ist eine Chance, KI-Adoption strukturiert und sicher zu beschleunigen. Unternehmen, die sie ernst nehmen, profitieren doppelt: Sie reduzieren Compliance-Risiken und erhöhen die Wertschöpfung pro Tool. Wer sie ignoriert, riskiert ab August 2026 zumindest eine unangenehme Behörden-Korrespondenz – und in der Zwischenzeit jeden Tag, dass die nächste falsch eingesetzte KI-Antwort einen ganz realen Schaden verursacht.

KI-Schulungspflicht praxisnah umsetzen – ohne PowerPoint-Müdigkeit

Plotdesk bündelt Multi-Modell-Zugang, ein durchdachtes Berechtigungs- und Audit-System sowie modulare Lernpfade direkt auf der Plattform – damit Ihre Mitarbeiter dort lernen, wo sie auch arbeiten. In unserem KI-Workshop „Strategie für den Mittelstand" erarbeiten wir mit Ihrem Team in einem Tag, welche Kompetenzlevel in Ihrem Unternehmen wirklich nötig sind – und wie das Schulungsprogramm bis zum 2. August 2026 steht.

Quellen und weiterführende Links:

- Verordnung (EU) 2024/1689 (KI-Verordnung), EUR-Lex: eur-lex.europa.eu

- AI Office FAQ „AI Literacy – Questions & Answers": digital-strategy.ec.europa.eu

- Bitkom-Pressemitteilung „Digitalisierung der Wirtschaft" (11. März 2026): bitkom-research.de

- TÜV-Verband Pressemitteilung „KI-Schulungen in Unternehmen verdoppelt": tuev-verband.de

- BMDS-Pressemitteilung zur KI-MIG-Kabinettsbefassung (11. Februar 2026): bmds.bund.de

- Council of the EU Pressemitteilung zum Digital Omnibus (7. Mai 2026): consilium.europa.eu

Hinweis: Dieser Artikel ist eine inhaltliche Orientierung, keine Rechtsberatung. Für die konkrete Bewertung Ihres Einzelfalls binden Sie bitte Ihre Datenschutzbeauftragten und/oder spezialisierten Rechtsbeistand ein.